Facebook e le regole opache: quando chiedere aiuto diventa “truffa”

Facebook e le regole opache: quando chiedere aiuto diventa “truffa”

Moderazione automatica, segnalazioni e algoritmi: quando il confine tra tutela e censura diventa sottile

Succede sempre più spesso, e quando succede lascia una sensazione precisa, difficile da ignorare Non tanto quella di aver violato una regola, ma quella di non aver mai capito davvero quale regola si sia infranta Un contenuto pubblicato, una richiesta di aiuto tramite PayPal, qualcosa che sui social è diventato ormai quasi normale, e nel giro di poco tempo arriva la risposta della piattaforma contenuto rimosso profilo limitato visibilità ridotta La motivazione, almeno sulla carta, è chiara il contenuto potrebbe promuovere prodotti o servizi fuorvianti e quindi rientrare nella categoria di possibili truffe Il problema è che tra “potrebbe” e “è” c’è un mondo intero, e in quel mondo ci finiscono dentro persone reali, storie reali e situazioni che non hanno nulla a che vedere con frodi o raggiri È qui che il sistema mostra il suo lato più fragile, perché la moderazione non è più una valutazione ma diventa un filtro automatico, costruito per prevenire abusi ma incapace, spesso, di distinguere tra un tentativo di inganno e una richiesta di aiuto Nel caso specifico, il risultato è evidente una foto rimossa un contenuto classificato come rischio truffa un profilo definito “non raccomandabile” E tutto questo senza un passaggio intermedio realmente comprensibile per l’utente Non viene spiegato cosa, nel concreto, renda quel contenuto ingannevole non viene chiarito quale elemento abbia attivato il blocco non viene data una linea precisa su come evitare lo stesso problema in futuro Resta solo una conseguenza meno visibilità Ed è qui che il discorso si allarga Perché Facebook non è solo una piattaforma è un sistema che decide cosa viene visto e cosa no cosa può crescere e cosa deve rallentare cosa è “sicuro” e cosa no E quando questo sistema inizia a classificare come sospette anche situazioni legittime, il rischio non è solo quello di bloccare contenuti sbagliati ma anche quello di silenziare contenuti veri Il punto non è negare che le truffe esistano, perché esistono e sono un problema reale il punto è capire quanto il sistema sia in grado di distinguerle da tutto il resto Perché se ogni richiesta di aiuto può essere interpretata come un tentativo di inganno, allora il problema smette di essere la sicurezza e diventa la generalizzazione E la generalizzazione, nei sistemi automatici, è sempre pericolosa Nel frattempo l’utente resta con una penalizzazione concreta, un profilo limitato e una domanda semplice a cui nessuno risponde davvero Cosa ho fatto esattamente E soprattutto Come faccio a non rifarlo Perché senza una risposta chiara, la moderazione smette di essere uno strumento e diventa un’incertezza E quando l’incertezza entra in un sistema che controlla la visibilità, il risultato è uno solo non si sa più dove finisce la tutela e dove inizia il blocco

Approfondimenti multimediali

Correlati

Continua a leggere

Torino e Bologna, due narrazioni a confronto: scontri, proteste e il ruolo dell’informazione

Ordine pubblico, proteste locali e percezione mediatica: quando il racconto cambia da città a città

Gli scontri a Torino dominano i titoli, con reazioni istituzionali immediate. A Bologna, invece, la protesta locale trova meno spazio e una narrazione diversa. Una riflessione critica solleva un tema ricorrente: il peso selettivo dell’attenzione mediatica.

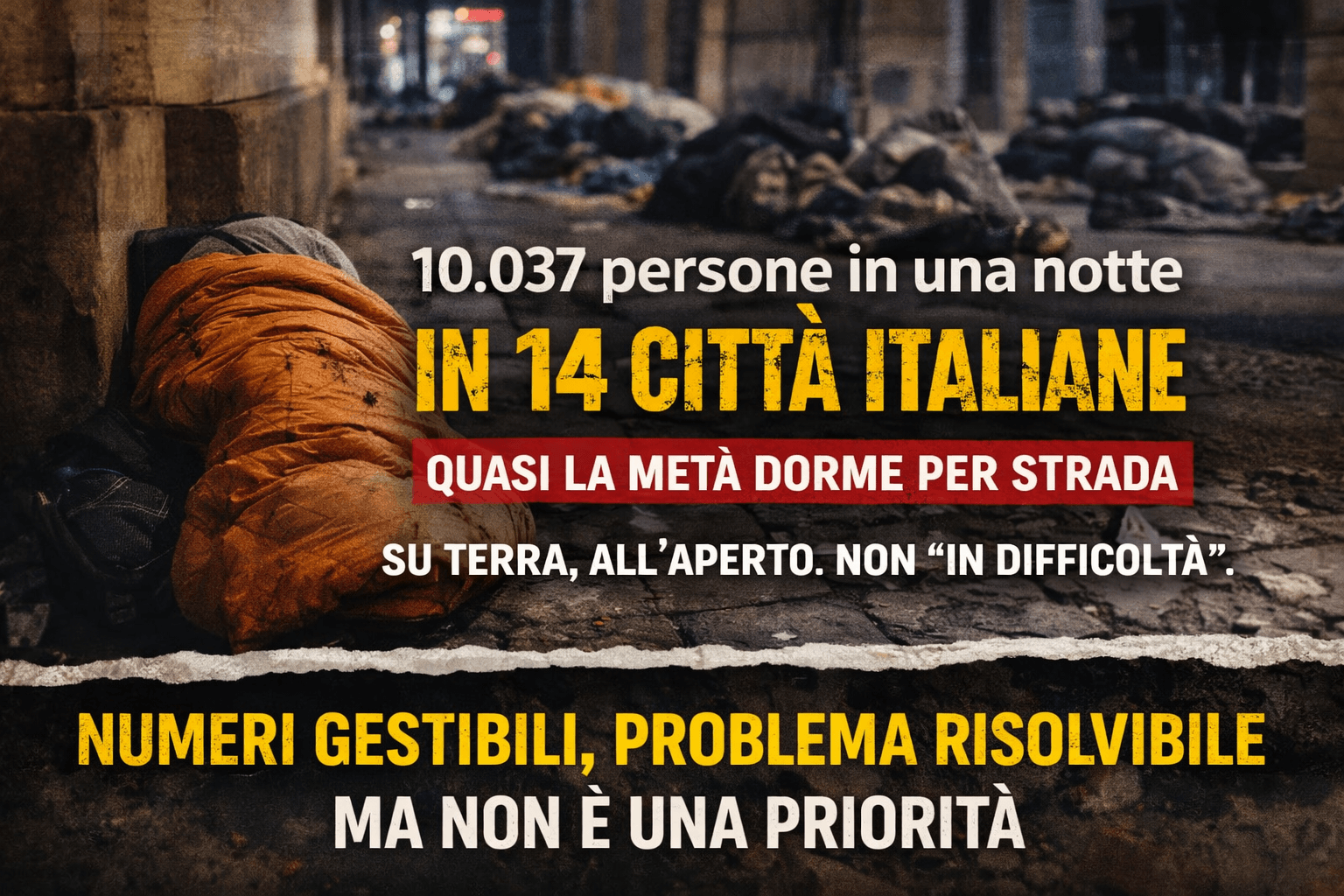

Pochi numeri, grande problema: quando l’emergenza non fa abbastanza rumore

Povertà estrema e servizi insufficienti: cosa racconta davvero il dato ISTAT

Un’indagine ISTAT fotografa una notte qualunque in 14 città italiane: oltre 10.000 persone senza dimora, quasi la metà costretta a dormire per strada. Numeri limitati nel tempo ma sufficienti a porre una domanda scomoda: il problema è davvero troppo grande… o semplicemente poco considerato?